人工智能领域再次迎来重磅更新。据多家媒体报道,OpenAI正式发布了其最新的图像生成模型——ChatGPT Images 2.0。与之前的版本相比,这款新模型在真实感和细节处理上实现了质的飞跃,生成的图片不仅精准、可用,甚至达到了“像素级”复刻现实的程度,让许多网友感叹:“眼见为实”的信任基础正在被动摇。

“一眼假”成为过去式

过去我们看到的AI生成图片,总带有一种难以言喻的“塑料感”或违和感。但Images 2.0彻底打破了这种刻板印象。它生成的图片细节丰富到令人震惊,无论是光影、纹理还是人物神态,都极度逼真。更关键的是,这些图片在直接输出时,并不会附带任何“AI生成”的水印或提示,这给辨别真伪带来了极大的困难。

简单的几个词,就能换来一张足以乱真的照片,这让许多网友既兴奋又担忧。

️ 逼真的背后:风险与挑战并存

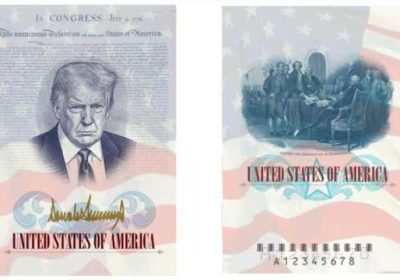

技术的进步是一把双刃剑。随着Images 2.0的问世,网络上已经开始出现各种以假乱真的AI伪造图片,例如:

名人代言官宣图(如库克“入职”小米)

虚假的名人合影

伪造的聊天记录截图

模拟的新闻报道画面

这些图片的传播引发了公众的广泛焦虑。网友们担心,不法分子可能会利用这种技术制作假照片诈骗老人,或者伪造证据进行网络暴力。电商行业也感到不安,担心过于真实的AI商品图会导致消费者产生误解,从而增加“仅退款”等售后纠纷。

️记者实测:真假难辨,平台如何应对?

为了验证其真实性,有记者进行了实际测试。结果显示,Images 2.0在生成图片时限制很少,从事故现场照片到国外电子驾照,再到完整的直播间界面,都能轻松生成。

在一次测试中,记者输入“生成一张马斯克直播卖货的画面”,AI不仅精准还原了直播间的UI设计,还模拟出了滚动的网友评论和互动数据,成品几乎与真实截图无异。不过,AI也并非完美无缺,在处理一些极小的文字、表情包或特殊标点时,偶尔会出现错乱,需要用户多次调整指令来优化。

当这些由AI生成的图片被发布到社交平台后,在长达24小时的时间里,它们并未被系统识别并标记,传播状态一切正常,只是阅读量普遍不高。

面对这一挑战,各大平台也纷纷亮明了态度:

某常用聊天软件

客服回应称,目前App内没有内置的AI图片自动检测工具,也没有“疑似AI”的提示功能。对于未来是否会增加此类功能,暂无明确消息。

某短视频平台

建议用户在发布作品时主动声明内容为AI生成。平台后期会通过系统和人工进行审核。同时,平台正持续投入资源,致力于提升对AI生成内容的识别和处置能力,以应对侵权成本低、数量大等新挑战。

微博

官方账号发文表示,注意到AI生成模型能力的显著提升,但也意识到不合理使用带来的风险。站方呼吁与广大创作者共同努力,推动AI技术健康、有序地发展。

小红书

发布了明确的AI治理规则,鼓励创作者如实标注AI内容。如果创作者未主动标注,平台在识别后会统一添加标识。同时,平台也上线了申诉通道,供创作者对误判提出异议。